知道这十大趋势 你就能了解未来的人工智能

随着Google、Microsoft和Facebook等巨头的大力投入,深度学习正在超出机器学习,人工智能来势凶悍。那末,如今人工智能最热门的技术趋势是甚么?

黑匣认为,复杂神经网络、LSTMs(长短时间记忆网络)、注意力模型(Attention Models)等10大趋势将塑造人工智能未来的技术格局。

上述判断来自NIPS(神经信息处理系统) 2015大会。NIPS始于1987年,是人工智能领域两大重要学习会议之1,由于AI的爆炸式发展,最近几年来逐步成为许多硅谷公司必须参加的年度会议。 在蒙特利尔召开的NIPS 2015吸引了众多AI学界与业界的顶级专家,预会人数接近4000。大会总共收录了403篇论文,其中深度学习课题约占11%。来自Dropbox的高级软件工程师Brad Neuberg分享了他所注意到的10大技术趋势,黑匣将对每种趋势做了详细分析。

1、神经网络的架构正变得愈来愈复杂

感知和翻译等大多数神经网络的架构正变得愈来愈复杂,远非此前简单的前馈神经网络或卷积神经网络所能比。特别需要注意的是,神经网络正与不同的技术(如LSTMs、卷积、自定义目标函数等)相混合。

神经网络是多数深度学习项目的根基。深度学习基于人脑结构,1层层相互连接的人工摹拟神经元模仿大脑的行动,处理视觉和语言等复杂问题。这些人工神经网络可以搜集信息,也能够对其做出反应。它们能对事物的外形和声音做出解释,还可以自行学习与工作。

(人工摹拟神经元试图模仿大脑行动 | 图片来源:Frontiers)

但这1切都需要极高的计算能力。早在 80 年代早期,Geoffrey Hinton和他的同事们就开始研究深度学习。但是彼时电脑还不够快,不足以处理有关神经网络的这些庞大的数据。当时AI研究的普遍方向也与他们相反,人们都在寻觅捷径,直接摹拟出行动而不是模仿大脑的运作。

随着计算能力的提升和算法的改进,今天,神经网络和深度学习已成为人工智能领域最具吸引力的流派。这些神经网络还在变得更复杂,当年“谷歌大脑”团队最开始尝试“无监督学习”时,就动用了1.6万多台微处理器,创建了1个有数10亿连接的神经网络,在1项实验中观看了千万数量级的YouTube图象。

2、酷的人都在用LSTMs

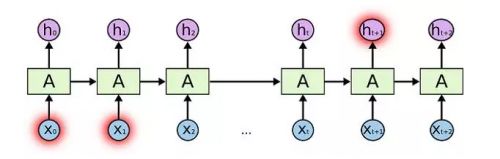

当你浏览本文时,你是在理解前面词语的基础上来理解每一个词语的。你的思想具有连续性,你不会抛弃已知信息而从头开始思考。传统神经网络的1大缺点便是没法做到这1点,而递归神经网络(RNN)能够解决这1问题。

RNN具有循环结构,可以延续保存信息。过去几年里,RNN在语音辨认和翻译等许多问题上获得了难以置信的成功,而成功的关键在于1种特殊的RNN——长短时间记忆网络(LSTMs)。

普通的RNN可以学会预测“the clouds are in the sky”中最后1个单词,但难以学会预测“I grew up in France… I speak fluent French。”中最后1个词。相干信息(clouds、France)和预测位置(sky、French)的间隔越大,神经网络就越加难以学习连接信息。这被称为是“长时间依赖关系”问题。

(长时间依赖问题 | 图片来源:CSDN)

LSTMs被明确设计成能克服之1问题。LSTMs有4层神经网络层,它们以特殊的方式相互作用。这使得“能记住信息很长1段时间”可以被视作LSTMs的“固有行动”,它们不需要额外学习这1点。对大多数任务,LSTMs已获得了非常好的效果。

3、是时候注意“注意力模型(attention models)了

LSTMs是人们使用RNNs的1个奔腾。还有其他奔腾吗?研究者共同的想法是:“还有注意力(attention)!”

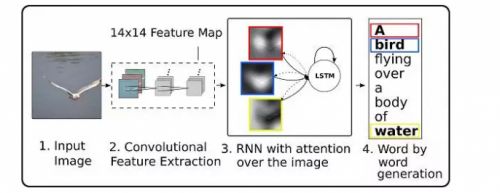

“注意力”是指神经网络在履行任务时知道把焦点放在何处。我们可让神经网络在每步都从更大的信息集中挑选信息作为输入。

例如,当神经网络为1张图片生成标题时,它可以挑选图象的关键部份作为输入。

(具有“注意力”的RNN在图象辨认中的成功应用 | 图片来源:Github)

4、神经图灵机仍然有趣,但还没法胜任实际工作

当你翻译1句话时,其实不会逐一辞汇进行,而是会从句子的整体结构动身。机器难以做到这1点,这1挑战被称为“强耦合输出的整体估计”。NIPS上很多研究者展现了对跨时间、空间进行耦合输出的研究。

神经图灵机(Neural Turing Machine)就是研究者们在硅片中重现人类大脑短时间记忆的尝试。它的背后是1种特殊类型的神经网络,它们可以适应与外部存储器共同工作,这使得神经网络可以存储记忆,还能在尔后检索记忆并履行1些有逻辑性的任务。

(模仿人类短时间工作记忆的神经图灵机 | 图片来源:arXiv)

2014年10月,Google DeepMind公布了1台原型电脑,它可以模仿1些人类大脑短时间工作记忆的特性。但直到NIPS2015,所有的神经图灵机都过于复杂,并且只能解决1些“小玩具”问题。在未来它们或将得到极大改进。

5、深度学习让计算机视觉和自然语言处理不再是孤岛

卷积神经网络(CNN)最早出现在计算机视觉中,但现在许多自然语言处理(NLP)系统也会使用。LSTMs与递归神经网络深度学习最早出现在NLP中,但现在也被纳入计算机视觉神经网络。

另外,计算机视觉与NLP的交汇依然具有无穷前景。想象1下程序为美剧自动嵌入中文字幕的场景吧。

6、符号微分式愈来愈重要

随着神经网络架构及其目标函数变得日趋复杂和自定义,手动推导出“反向传播”(back propagation)的梯度(gradients)也变得更加苦难而且容易出错。谷歌的TensorFlow等最新的工具包已可以超负荷实验符号微分式,能够自动计算出正确的微分,以确保训练时误差梯度可被反向传播。

7、神经网络模型紧缩的惊人成果

多个团队以不同方法大幅紧缩了训练1个良好模型所需的素材体量,这些方法包括2值化、固定浮点数、迭代修剪和精细调优步骤等。

这些技术潜伏的利用前景广阔,可能将会适应在移动装备上进行复杂模型的训练。例如,不需要延迟就能够得到语音辨认结果。另外,如果运算所需要的空间和时间极大下降,我们就能够极高帧率(如30 FPS)查询1个模型,这样,在移动装备上也能够应用复杂神经网络模型,从而近乎实时地完成计算机视觉任务。

8、深度学习和强化学习继续交汇

虽然NIPS 2015上没有甚么强化学习(reinforcement learning)的重要成果,但“深度强化学习”研讨会还是展现了深度神经网络和强化学习相结合的前景。

在“端对端”(end-to-end)机器人等领域出现了使人激动的进展,现在机器人已可以1起应用深度和强化学习,从而将原始感官数据直接转化为实际动作驱动。我们正在超出“分类”等简单工作,尝试将“计划”与“行动”纳入方程。还有大量工作需要完成,但初期的工作已令人感到兴奋。

9、难道你还没有使用批标准化?

批标准化(batch normalization)现在被视作评价1个神经网络工具包的部份标准,在NIPS 2015 上被不断提及。

10、神经网络研究与优化齐头并进

创造新的神经网络方法需要研究者,还需要能将它们迅速付诸实践的方法。谷歌的TensorFlow是少数能够做到这些的库:使用Python 或 C++等主流编程语言,研究者可以迅速创作新的网络拓扑图,接着在单1或多个装备(包括移动装备)上进行测试。

-

张艺谋妻女晒自拍母女颜值爆表

明星,怎么说也是个人吧。时不时晒晒照片,来个自拍什么的不足为奇。明星张婷与其女儿,在平安夜当晚晒自拍...[详细]

-

视帝陈豪爱妻陈茵媺爬山遇发哥为拍贴脸合照

视帝陈豪的爱妻陈茵媺“野生捕获”到周润发,抛开丈夫,完全放下矜持,就像树熊那样缠绕树干般搂紧周润发脖...[详细]

-

蒙面唱将猜猜猜第三季播出时间

《蒙面唱将猜猜猜》第三季于2018年10月21号每周日晚21:10分播出。《蒙面唱将猜猜猜》是江苏卫视的王牌节目,201...[详细]

-

郑爽才是中国好老板让助理出演角色进军娱乐

在年初的时候说到 中国好老板 ,大家的第一直觉就是我们的大幂幂了,用一部《三生三世十里桃花》把旗下的艺人...[详细]

-

盘点娱乐圈当下最俊朗的五大男神你喜欢哪一

靳东,1976年12月22日出生于山东,中国内地男演员。1993年,在电视剧《东方商人》中饰演少年高显扬;2005年,出演...[详细]

-

-

西门子医疗和柏林夏里特医学院共同推广预防医学创新理念

双方签署预防医学联合研究合作协议 提高对

-

逆势完成C1轮融资并开启C2轮融资,数问生物加速全球化市场布局

湖州德清2025年7月9日 /美通社/ --

-

阿科玛在新加坡投资新的RILSAN® CLEAR透明聚酰胺生产装置

中国上海和法国巴黎 2025年7月9日 /美通社/ -- 继

-

从医院绿地到市民公园,和睦家静安院区雷士德花园"变身"城市疗愈空间

上海 2025年7月8日 /美通社/ -- 曾经的医院内部绿

-

驯鹿生物伊基奥仑赛注射液(Fucaso)获韩国食品药品安全部孤儿药资格认定

南京、上海和美国旧金山 2025年

-

TÜV莱茵携手成都医疗器械行业协会举办出海经验分享研讨会

成都 2025年7月8日 /美通社/ -- 日

-

-

-

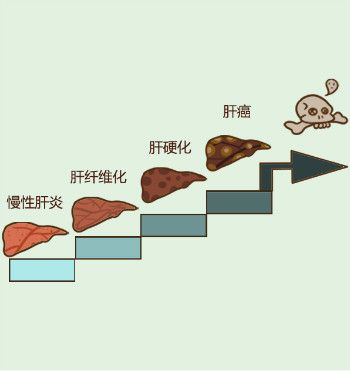

肝纤维化不能吃什么?肝纤维化饮食的注意事项有哪些?

中国人口14亿多,其中有9000万乙肝病毒感染者

-

肝硬化需要全疗程用药吗?哪个品牌的软肝片好?用药讲疗程,安全有保证!

人们常说“慢性病要以慢治慢”。古人倡导“

-

肝硬化的突出表现有哪些?用什么药软肝效果好?保肝软肝就选中成药

肝硬化是一种常见慢性病,引起肝硬化的病因

-

肝硬化的前期表现有哪些?肝硬化前期该如何选择软肝药品呢?

中国人的饮酒文化众所皆知,都特别喜欢酒桌

-

肝硬化患者吃什么药好,复方鳖甲软肝片有效吗?疗效值得认可

我国是肝病高发生率大国,每年有超过120万病

-

肝硬化吃复方鳖甲软肝片怎么样?复方鳖甲软肝片功效与作用来评价

肝硬化是一种常见的慢性肝病,是由一种或多

-

-

-

-

-

-

-

-

-

-

-

-

-

优养在线

优养在线